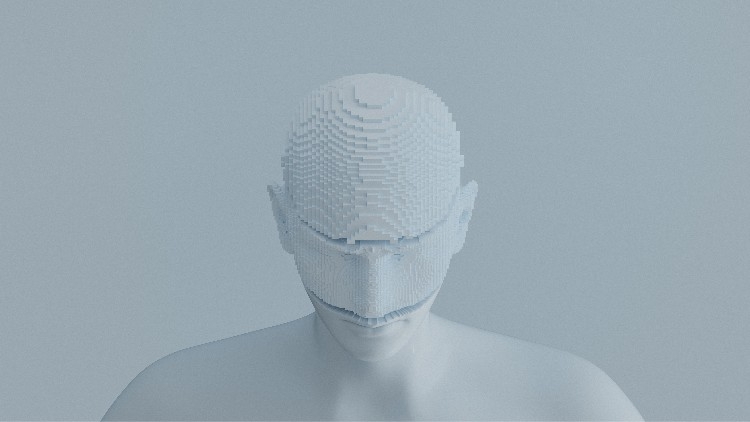

A declaração é assinada por figuras ligadas à inteligência artificial, como é o caso do CEO do Google DeepMind e da própria OpenAI, empresa mãe do Chat GPT

|

“Mitigar o risco de extinção da IA deve ser uma prioridade global juntamente com outros riscos de escala social, como as pandemias e a guerra nuclear”. Este é o mais recente alerta sobre a alegada ameaça da inteligência artificial para a Humanidade, que partiu de um grupo composto por investigadores, engenheiros e CEO, entre eles o CEO do Google DeepMind e da própria OpenAI, empresa mãe do ChatGPT. A declaração foi publicada pelo Center for AI Safety, uma organização sem fins lucrativos com sede em São Francisco, nos EUA, e co-assinada por um conjunto de figuras ligadas à inteligência artificial, como é o caso de Demis Hassabis, CEO do Google DeepMind, Sam Altman, CEO da OpenAI, Geoffrey Hinto e Youshua Bengio, dois dos três investigadores que venceram o Prémio Turing de 2018 pelo trabalho desenvolvido sobre a inteligência artificial. Esta não é, contudo, a primeira tentativa para chamar à atenção para as possíveis consequências da inteligência artificial na sociedade, uma vez que no início do ano uma outra carta aberta tinha sido já assinada por muitos daqueles que assinaram agora a nova declaração. A anterior carta, que pedia uma pausa de seis meses no desenvolvimento da IA, foi criticada a vários níveis, com muitos especialistas a concordarem com os riscos indicados, mas a sublinharem a falta de sugestões para contornar a problemática. Em declarações ao jornal ‘The New York Times’, Dan Hendrycks, diretor executivo do Center for AI Safety, afirmou que a declaração emitida não tinha como objetivo gerar desacordo sobre a forma como a ameaça criada pela inteligência artificial pode ser mitigada. Dan Hendrycks defendeu no ‘The Times’ que a mensagem simbolizaria uma “saída” para muitas das figuras ligadas à indústria da IA e preocupadas com a evolução dos riscos da mesma. As opiniões dos especialistas dividem-se quanto aos cenários possíveis criados por esta tecnologia: por um lado aqueles que defendem a necessidade de melhorias nos sistemas de forma a obter ganhos com a IA; por outro aqueles que acreditam que poderá tornar-se impossível controlar as ações da IA se os seus sistemas atingirem um elevado nível de sofisticação. Há ainda quem duvide da capacidade dos sistemas de inteligência artificial para determinadas tarefas. |